ChatGPT يضع علامات رقمية على صور DALL-E 3 للمساعدة في مكافحة المعلومات الخاطئة

في العصر الذي يستخدم فيه المحتالون الذكاء الاصطناعي التوليدي للاحتيال على الأموال أو تشويه سمعة الأشخاص، تبتكر شركات التكنولوجيا طرقًا لمساعدة المستخدمين على التحقق من المحتوى – على الأقل الصور الثابتة، للبدء بها. كما تم الإعلان عنه في استراتيجية المعلومات الخاطئة لعام 2024، تقوم OpenAI الآن بتضمين بيانات تعريف المصدر في الصور التي تم إنشاؤها باستخدام ChatGPT على الويب وDALL-E 3 API، مع حصول نظيراتها المحمولة على نفس الترقية بحلول 12 فبراير.

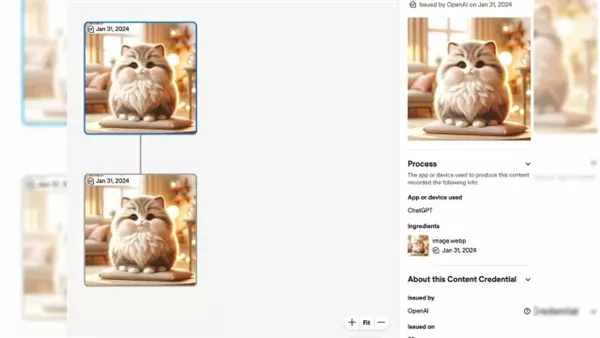

تتبع البيانات التعريفية المعيار المفتوح C2PA (تحالف مصدر المحتوى والأصالة)، وعندما يتم تحميل إحدى هذه الصور إلى أداة التحقق من بيانات اعتماد المحتوى، ستتمكن من تتبع نسب مصدرها. على سبيل المثال، ستعرض الصورة التي تم إنشاؤها باستخدام ChatGPT بيان بيانات التعريف الأولي الذي يشير إلى أصل DALL-E 3 API الخاص بها، متبوعًا ببيان بيانات التعريف الثاني الذي يوضح ظهورها في ChatGPT.

على الرغم من تقنية التشفير الرائعة وراء معيار C2PA، فإن طريقة التحقق هذه لا تعمل إلا عندما تكون البيانات الوصفية سليمة؛ لن تكون الأداة ذات فائدة إذا قمت بتحميل صورة تم إنشاؤها بواسطة الذكاء الاصطناعي بدون بيانات وصفية – كما هو الحال مع أي لقطة شاشة أو صورة تم تحميلها على وسائل التواصل الاجتماعي. ومن غير المستغرب أن عينات الصور الحالية الموجودة على صفحة DALL-E 3 الرسمية عادت فارغة أيضًا. في صفحة الأسئلة الشائعة الخاصة بها، تعترف OpenAI بأن هذه ليست حلاً سحريًا لمعالجة حرب المعلومات الخاطئة، ولكنها تعتقد أن المفتاح هو تشجيع المستخدمين على البحث بنشاط عن مثل هذه الإشارات.

في حين أن أحدث جهود OpenAI لإحباط المحتوى المزيف تقتصر حاليًا على الصور الثابتة، فإن DeepMind من Google لديه بالفعل SynthID لوضع العلامات المائية رقميًا على كل من الصور والصوت الناتج عن الذكاء الاصطناعي. وفي الوقت نفسه، تقوم Meta باختبار العلامات المائية غير المرئية عبر مولد الصور AI الخاص بها، والذي قد يكون أقل عرضة للتلاعب.